Pendahuluan

Dalam dunia kecerdasan buatan (AI), training model adalah proses yang memakan waktu dan sumber daya. Di sinilah CUDA dari NVIDIA berperan penting. CUDA (Compute Unified Device Architecture) adalah platform komputasi paralel yang memungkinkan GPU NVIDIA mempercepat proses training AI secara signifikan. Artikel ini akan membahas bagaimana CUDA memengaruhi training AI dan mengapa GPU NVIDIA menjadi pilihan utama para peneliti dan pengembang.

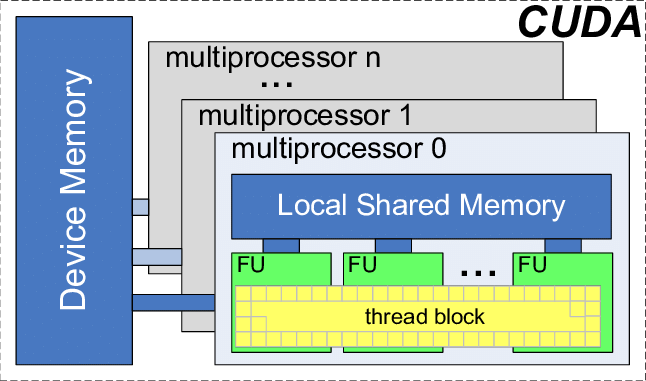

1. Apa Itu CUDA?

CUDA adalah teknologi yang dikembangkan oleh NVIDIA untuk memungkinkan GPU melakukan komputasi umum (GPGPU). Dengan CUDA, pengembang dapat memanfaatkan ribuan core GPU untuk memproses data secara paralel, yang sangat cocok untuk tugas-tugas training AI 1.

2. Mengapa CUDA Penting untuk Training AI?

- Pemrosesan Paralel: CUDA memungkinkan pemrosesan data secara paralel, yang mempercepat proses training model AI hingga ratusan kali lipat dibandingkan CPU 2.

- Optimasi untuk Deep Learning: Framework seperti TensorFlow dan PyTorch telah dioptimalkan untuk CUDA, memungkinkan pengguna memanfaatkan GPU NVIDIA dengan efisien.

- Skalabilitas: CUDA mendukung penggunaan multi-GPU, memungkinkan training model yang lebih besar dan kompleks.

3. Keunggulan GPU NVIDIA dalam Training AI

- Performa Tinggi: GPU NVIDIA dengan arsitektur CUDA menawarkan performa yang jauh lebih tinggi untuk tugas-tugas komputasi intensif seperti training AI 3.

- Dukungan Framework: NVIDIA mendukung berbagai framework AI populer, termasuk TensorFlow, PyTorch, dan Keras.

- Ekosistem yang Matang: NVIDIA menyediakan alat dan library seperti cuDNN (CUDA Deep Neural Network) untuk mempercepat proses training.

4. Contoh Penggunaan CUDA dalam AI

- Computer Vision: CUDA digunakan untuk mempercepat training model pengenalan gambar dan video.

- Natural Language Processing (NLP): Model NLP seperti GPT dan BERT dapat di-training lebih cepat dengan CUDA.

- Reinforcement Learning: CUDA memungkinkan simulasi lingkungan yang kompleks untuk training model RL.

5. Tips Memaksimalkan CUDA untuk Training AI

- Pilih GPU yang Tepat: Pastikan Anda menggunakan GPU NVIDIA dengan arsitektur CUDA terbaru untuk performa optimal.

- Optimasi Kode: Gunakan library seperti cuDNN dan TensorRT untuk memaksimalkan efisiensi komputasi.

- Manajemen Memori: Pastikan memori GPU digunakan secara efisien untuk menghindari bottleneck.

- Pelajari Dokumentasi Resmi: Sumber daya seperti NVIDIA Developer Blog dan CUDA Toolkit Documentation sangat membantu 4.

Kesimpulan

CUDA telah menjadi tulang punggung dalam training AI modern, memungkinkan pengembang dan peneliti untuk mempercepat proses komputasi dengan GPU NVIDIA. Dengan performa tinggi, dukungan framework yang luas, dan ekosistem yang matang, CUDA adalah pilihan utama bagi siapa pun yang serius dalam mengembangkan AI. Mulailah memanfaatkan CUDA hari ini untuk meningkatkan efisiensi dan kecepatan training model AI Anda!